QuickQ通过改善网络通道质量(低延迟、低丢包、优选路由)与带宽管理,能显著缩短云端人脸识别的往返时间;配合本地预处理、分流与批量策略,可以在用户端体验上看到明显加速和更高吞吐。

先把问题拆开,像给朋友讲一样

人脸识别其实是两部分:一边是“拍照/采集+预处理”,另一边是“把数据发到模型(通常在云端)并等待结果返回”。网络影响的是后半段——把图片或视频帧从设备送到云端,以及把识别结果送回来的时间。QuickQ作为一种智能网络加速工具,它能做的是优化这条“来回路”。

为什么网络会拖慢人脸识别?

- 延迟(Latency):每次请求都要经历往返时间,延迟高意味着响应慢,尤其影响实时视频或交互式场景。

- 丢包与重传:丢包会触发重传或影响流媒体稳定性,导致卡顿或帧丢失。

- 抖动(Jitter):时延波动会让流式识别的帧率不稳定。

- 带宽不足:高分辨率图片或多路视频流需要上传大量数据,带宽受限会成为瓶颈。

- 路由不优/跨境链路慢:如果到识别服务器经过多跳或绕道,实际延时会被拉长。

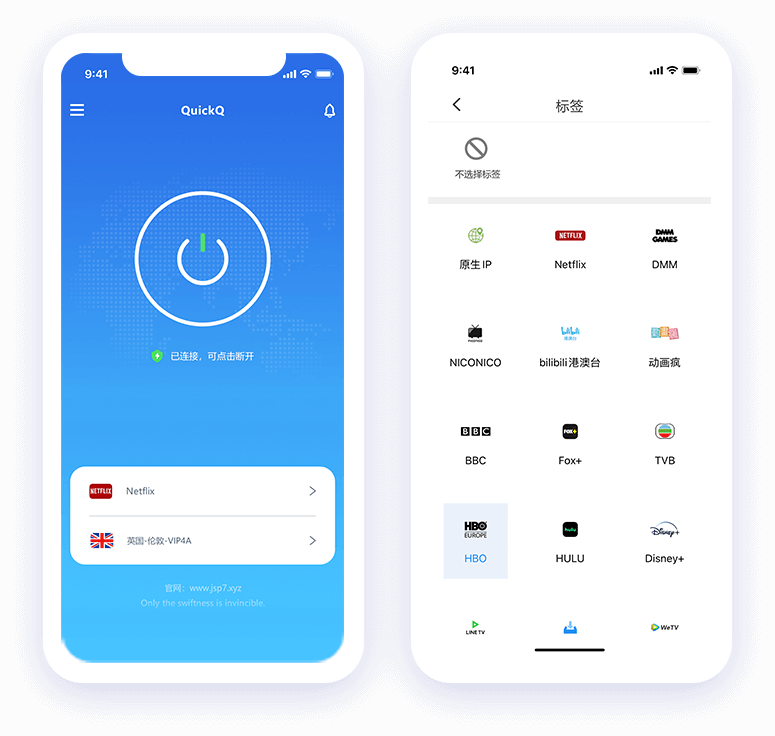

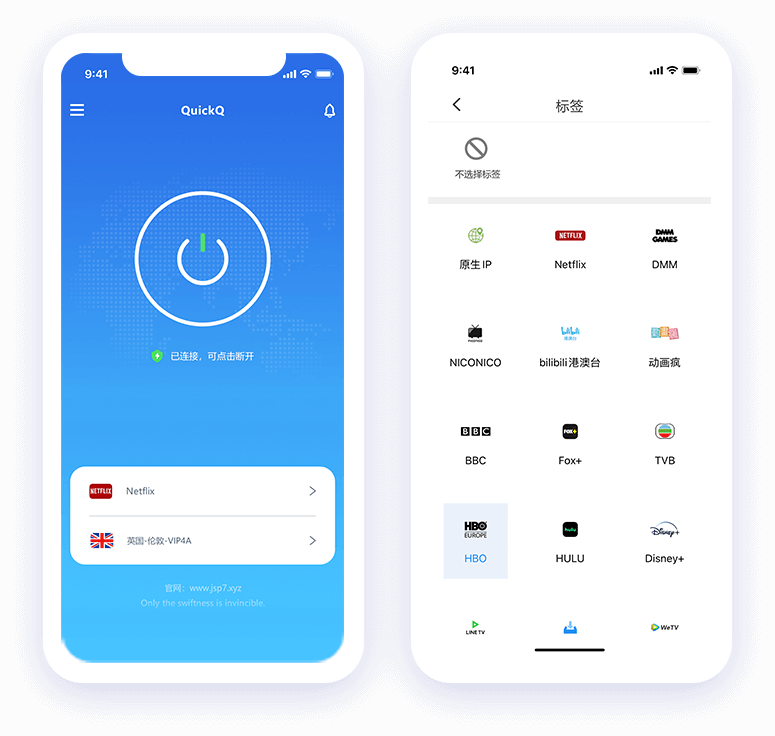

QuickQ能做什么?(真实可行的加速手段)

把技术讲清楚:QuickQ并不是“让识别模型跑得更快”的工具,而是让数据更快、更稳定地到达模型所在的地方。常见的手段有:

- 智能路由优化:选择到目标云端或CDN节点最短/最稳定的路径,避免跨境绕行。

- UDP/QUIC优先:对实时传输(比如WebRTC或低延迟API)优先使用基于UDP或QUIC的通道,减少握手和重传开销。

- 分流/拆包:把需要加速的识别流量走加速通道,非关键流量不走隧道,减少干扰(即“分流/绕过VPN”)。

- 带宽管理与QoS:在节点或通道上做带宽保证与优先级调度,保证识别数据有稳定出口。

- 边缘节点与CDN接入:把数据先送到离用户更近的边缘,再由边缘转发到模型,减少长链路传输。

- 固定出口/白名单IP:对接云端服务时使用固定出口IP,减少认证或IP变动带来的延时/重试。

用费曼方法再说一次(更浅显)

想象你把信递给远方的朋友:邮差有快路也有慢路,QuickQ就是找快路、派优先邮车、偶尔把包裹先送到离目的地更近的中转站。你也可以在发信前把信写短一点(图片压缩、裁剪),这样总时间更短。

实操指南:如何把QuickQ与人脸识别流程配合起来(Windows/Android/macOS)

下面的步骤是通用的、以Feynman思想拆解为小步,便于检验和调整。

第一步:确定识别架构(本地 vs 云)

- 如果模型在本地运行:网络优化影响很小,重点是本地硬件与并发。

- 如果模型在云端(最常见):网络就是关键,下面的步骤主要针对这一情况。

第二步:节点选择与延迟测试

- 用Ping/Traceroute或QuickQ内置测速,找出延迟最低且丢包最少的节点。

- 优先选最近的边缘节点或与识别服务同一区域的出口。

第三步:启用优化协议与分流

- 优先启用QUIC/UDP选项(如果QuickQ支持),用于实时视频或低延迟API。

- 开启分流(split tunneling):把识别API流量走加速通道,其他如下载或更新流量不走隧道。

第四步:调整传输参数(MTU/并发/批量)

- MTU通常设置在1400–1500之间以减少分片(跨境链路建议试1400)。

- 并发连接数:对批量请求可适度并发(根据服务器限额,通常5–20并发为宜)。

- 批量与压缩:把多张小图打包或压缩到合理分辨率(例如640×480或按模型要求),减少每次上传字节数。

第五步:本地预处理与降维

- 在设备端先做人脸检测/裁剪,只传人脸区域而不是整张大图。

- 使用合理的编码(JPEG质量70–85通常是个好平衡),或者WebP来减少带宽。

一些具体参数建议(可直接试验)

| 项目 |

建议值/说明 |

| 目标延迟 |

<50 ms(同城/边缘),100–200 ms 可接受交互式;>300 ms 感知明显变差 |

| 丢包率 |

<1% 最佳;>2% 开始影响质量 |

| MTU |

1400–1500(跨境链路尝试1400) |

| 图片尺寸 |

人脸裁剪后 160×160–640×640,按模型需求选择 |

| 并发 |

5–20 并发请求中等可靠;超出请结合后端限流 |

常见场景与对应优化策略

办公/远程面试(高实时性,单一路径)

- 优先选择低延迟节点、QUIC/UDP优先、开启分流排除非必要流量。

- 在客户端做轻量检测,只上传关键帧或关键人脸数据。

跨境电商/批量识别(高吞吐)

- 使用边缘节点进行前置聚合,采用批量上传并行化,服务器端做批处理。

- 保留固定出口IP方便云端白名单与更稳定的路由。

游戏/实时AR(极低延迟)

- 尽量把核心推断放到本地或近端边缘,当必须云端时使用最低延迟节点和UDP/QUIC。

- 减少每帧数据量,采用差分帧或只传关键点数据。

风险与合规注意(不要忽略)

- 隐私保护:传送人脸数据要遵循当地法律与服务端隐私政策,优先做本地模糊/加密/脱敏。

- 合规性:某些国家对跨境传输生物识别数据有严格限制,使用前核查法律要求。

- 安全性:加速不等于降低加密,仍应使用TLS/端到端加密并保证密钥管理。

调试清单(像做实验一样一步步验证)

- 测Baseline(不使用QuickQ时的RTT、丢包、吞吐)。

- 开启QuickQ常规节点,测延迟与丢包率变化。

- 切换最近边缘节点,测API响应时间(P95、P99)。

- 开启QUIC/UDP选项(如果有),与TCP对比。

- 启用分流策略,单独测识别流量性能提升幅度。

- 在真实场景下记录用户端感知(卡顿、响应、识别准确率是否受影响)。

最后说一句,网络优化是把“慢”变“稳”和“匀”,QuickQ类的加速工具能在很大程度上改善云端人脸识别的体验,但真正的效果来自多方面配合:本地预处理、合适的分辨率与压缩、正确的并发策略,再加上选对节点与协议。按上面的清单去做,边测边调,很快就能看到改进。